Фотографы давно занимались манипуляциями и вмешательствами в изображение, но прогресс генеративных технологий придает новый смысл идее «реального» изображения.

С развитием генеративных технологий, которые могут симулировать фотографию, создавая изображения математическими методами, появилась необходимость большей точности в описании изображений, созданных без применения этих технологий. Но как их называть? Термин «реальная фотография» был использован несколькими сайтами, освещающими новости техники, в заголовках опубликованных прошлым летом материалов о том, что Meta ошибочно определила архивные фотографии как «Созданные ИИ». Итак, «реальная фотография» – термин в достаточной степени интуитивно понятный, но вводящий в заблуждение, если не оксюморонный. Разве каждая фотография не является нереальной в том смысле, что она – изображение некоего предмета, а не предмет сам по себе? Разве «реальная фотография» не напоминает нам о том, каким сомнительным всегда оказывалось самоуверенное утверждение о том, что фотография объективно отражает реальность? Все фотографии на платформах Meta состоят из цифрового кода, а не из химикатов, нанесенных на бумагу. Разве это делает их ненастоящими?

Фраза «реальная фотография» не имеет смысла. Она приобретает его не в качестве описания онтологического статуса изображения, но лишь в качестве суждения о создателях его, их технике и, в конечном счете, их намерений, как будто реальность требует отказа от какой-то конкретной цели или человеческой точки зрения. По сути, работа ИИ по преобразованию текста в изображение состоит в том, что происходит статистическое усреднение миллионов «поглощенных» программой без разбора изображений, и в результате создается основанное на этой статистике представление любой придуманной и описанной концепции, извлекающее «реальную» сущность из статистических случайностей и эмпирических искажений. Однако, именно субъективность обычно позволяет нам считать изображение «реальным». Это как бы свидетельство того, что кто-то увидел нечто каким-то определенным образом, и нашел способ поделиться увиденным. Сгенерированные изображения противоречат нашему чувству реальности не обязательно потому, что слишком не похожи (или похожи) на изображаемый предмет, но потому, что обманывают нас, приписывая точку зрения синтезированному изображению.

Мы находим возрастающее напряжение в принятом представлении о «реальной фотографии». Этот термин применяется сейчас для того, чтобы фиксировать, что изображение на синтезировано (скорее, это субъективно), но также и в том смысле, что изображение не подделано более очевидным путем, не отредактировано для утверждения некого предвзятого мнения или цели (что не субъективно). Описанная выше ситуация с неверным определением в Meta отражает ошибку детектора подлинности, который был калиброван таким образом, что любую форму цифрового редактирования воспринимал как фальсифицирующее присутствие ИИ, ненамеренно стигматизируя обычные процессы ретуши, которые принято считать нефальсифицирующими. Смешивание любого постпродакшена с автоматической генерацией показывает, что понятие «Создано ИИ» не имеет ясного, стабильного определения вообще. «Если «ретушированная фотография» приравнивается к «Созданной ИИ», значит этот термин вообще лишен смысла», – пишет фотограф Ноа Калина (Noah Kalina) в Threads. «Если они так серьезно настроены защищать людей, можно с такой же степенью достоверности ставить под каждой фотографией вообще тег «Не является правдивым отражением реальности».

Трудно поверить, что платформа Meta так серьезно стремится защищать людей, учитывая ее репутацию, включающую разжигание ненависти и насилия, содействие коммерческому наблюдению и дискриминации, а также использование людей как подопытных морских свинок в необъявленных психологических экспериментах. Но даже если и поверить, непонятно, как такая метка может быть защитой, и каким образом Meta или любая другая коммерческая компания, имеющая интерес в максимальном потреблении медиа, может рассматриваться как надежный хранитель реальности. Кажется, надежнее серьезно отнестись к предупреждениям Калины и скорее воспринимать все, что размещается в социальных сетях, как эффективно фальсифицированную информацию, чем чувствовать себя призванным верить всему, если только Фейсбук не предупреждает вас о недостоверности. Ставка на маркировку контента не только представляла бы моральную опасность в смысле грамотности в обращении с медиа («Не беспокойтесь, медиаплатформы интерпретируют все за вас, вам незачем думать самому»), но и предполагала бы, что единственными «безопасными» изображениями являются те, что не требуют интерпретации. Это сводит пользовательский интерес к изображениям к прямой передаче информации. С такой точки зрения лучшими признаются те изображения, что распознаются с первого взгляда как «реальные» и передают информацию, словно укол шприца; это позволяет потреблять больше и быстрее.

Группа представителей индустрии технологии и медиа Content Authenticity Initiative критиковала подход Meta, утверждая, что только полностью созданные ИИ изображения должны нести метку «Создано ИИ». Но этот подход игнорирует суть проблемы: сложность проведения границы между тем, что «синтезируется», и тем, что «обрабатывается», что полностью размывает значение обоих понятий. Их предложение не только не инициирует создание аутентичного контента, но использует угрозу со стороны ИИ, чтобы закрепить привилегированное отношение к реальности фотографических технологий, неспособных его поддерживать, и СМИ, которые его не заслуживают. Более того, такие метки на изображениях фактически выставляют зрителя неспособным самостоятельно анализировать изображения, то есть, мы понимаем, что изображения бывают «правильными» и «неправильными», но не доверяем решать это зрителю с его несовершенными органами чувств. Кроме того, в разряд маргинальных переводятся такие приемы, как недоговоренность, неразрешимость и многозначность, и многие другие способы эстетического взаимодействия с изображением.

Метка «Сделано с помощью ИИ» предполагает, что в обычной ситуации каждый может определить, какие фотографии «реальны», а какие нет, просто глядя на них, без знания контекста, говорящего о том, почему изображение было изготовлено или опубликовано. Это неявная тема викторины, опубликованной на сайте New York Times в июне 2024 года, озаглавленной «ИИ развивается. Можете ли вы сказать, что сейчас реально?» На викторине были показаны серии фотографий знаменитостей и политиков, среди которых были замешаны яркие «хитовые» картинки, и часть из них была синтезирована с помощью ИИ. Вторя хорошо отрепетированной пугалке, связанной с дипфейками, сопроводительный текст говорит, что «фейковые изображения повышают риск быть обманутыми в интернете, а также риск подрыва доверия общественности, в том числе к подлинным изображениям». Общий вывод таков – если вы поверили, что фотография Дуэйна «Скалы» Джонсона в полицейском мундире в супермаркете реальна, это значит, что ИИ подавил вашу и так слабую аналитику, и стал угрозой миру, который мы знали раньше.

Но, если изображения, сгенерированные компьютером, трудно отличить от «реальных», это может говорить нам не только о мощи ИИ, но и в большей степени о том, как медийный контекст всегда определял наше понимание того, что мы видим, моделируя «реальность» знакомыми, шаблонными способами. Даже, если бы кто-то мог бы определить реальность на поверхности изображения, как это предполагает тест New York Times, это оставалось бы бесполезным навыком в абстрактном плане, не принося «ни пользы, ни удовольствия». Это не значит, что аудитория, даже потребители новостей, хотят только фактов. Распознание фейков в лабораторных условиях совсем ничего не говорит о том, как человек схватывает «риторику образа» (используя фразу Ролана Барта), и противоречит большей части удовольствия, которое получает зритель, рассматривая фотографии.

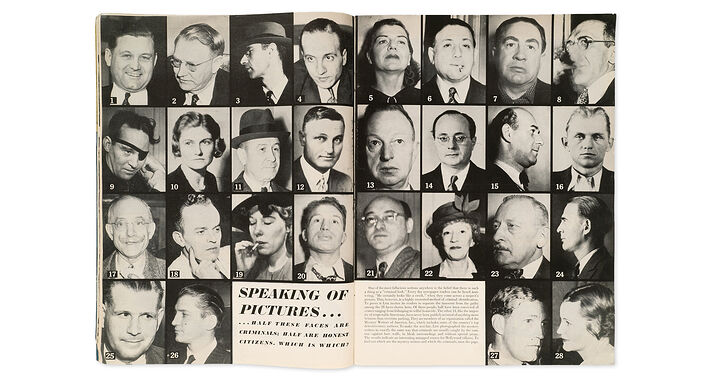

Викторина New York Times – отклик на викторину журнала Life 1947 года, о которой напомнил Фред Ритчин в своей книге 1990 года «В нашем собственном образе – грядущая революция в фотографии» (In Our Own Image: The Coming Revolution in Photography), раннем подходе к учету влияния цифровых изображений на фотографию. В той викторине читателям показывали серию снимков головы и предлагали решить, на каких из них изображены преступники, а на каких – писатели детективов. Целью было, видимо, избавить читателей от их физиогномических предубеждений. «Это был соблазнительный, квази-научный тест в своей сути», – пишет Ритчин, однако фотографии были «умно подобраны», чтобы сбить читателей с толку, подыгрывая и усиливая их стереотипы. Используя фотографии писателей с определенным освещением и ракурсом, редакторы Life надеялись сбить читателей с толку, приводя их к заключениям, подвергающим сомнению их возможность точно понимать окружающий мир. Как говорит Ритчин, «жизнь, якобы бросающая вызов стереотипам, на самом деле показала талант журнала направлять читателя».

Задумываться о том, какие изображения в викторине New York Times являются фейковыми, на самом деле означает не заботу о реальности как таковой, а заботу о возможности газеты диктовать ее, возможности выдавать предлагаемые редакцией за достойные доверия представления истины. Эти изображения также, по сути, генерируются, представляя концепцию в так или иначе преувеличенной или приукрашенной форме. Катастрофизация бессмысленных, но безобидных в целом вещей, таких как созданный ИИ «Иисус-креветка» на Facebook (которые в целом соответствуют ожиданиям от фразы) способствуют восстановлению более традиционных форм постановочных изображений в традиционных СМИ. Интересам и традиционных СМИ, и социальных сетей соответствовала бы ситуация, когда каждое изображение считается «фейком», если оно не подтверждено официально. Таким образом, получится, что только тот, кто имеет удостоверение прессы или верификацию платформы BlueCheck, может публиковать «настоящую» фотографию.

Многие синтезированные ИИ изображения не так уж отличаются от того, что Ритчин описывает как «редактированную фотографию»: изображения, которые «заимствуют у фотографии предполагаемый авторитет и в то же время манипулируют образами для своих собственных целей». Но синтезированные изображения отталкиваются не от авторитета фотографии, ее атмосферы документальной достоверности, а от того, как мы их часто воспринимаем: спонтанно, как будто их непосредственность говорит сама за себя и делает самоочевидными, а словесное уточнение должно выглядеть как нечто конкретное.

Книга In Our Own Image, опубликованная как раз тогда, когда цифровая фотография входила в широкий оборот, предполагает, что удовольствие от потребления фотографии все еще связано с ее подразумеваемым визуальным реализмом. «Предполагается, что сцена, сфотографированная напрямую, содержит людей и объекты, запечатленные на фотографии», – пишет Ритчин. «Привлекательность фотографии, даже очевидно монтированной или иным образом манипулированной, заключается в интуитивном ощущении, что изображение отражает осязаемую реальность». Аудитория, по его мнению, оказалась неподготовленной принять «фотографическую симуляцию». Он добавляет: «Если связь фотографии с физической реальностью внезапно станет слабой, словарь фотографии должен быть изменен, и ее система репрезентации потребует пересмотра».

Это переосмысление уже идет. Сейчас никто не знает, каким манипуляциям, монтажу и изменениям подвергалась та или иная фотография; почти каждый делал нечто подобное на своем телефоне. При этом способность генеративной модели синтезировать и дополнять изображения широко и постоянно рекламировалась, а мнимые предупреждения, такие как метки Meta «Создано ИИ», только добавляют ажиотажа. Но переосмысление не односторонне: люди стали свободнее выражать мысли с помощью изображений и лучше познакомились с возможностью цифровых манипуляций, они не стали в связи с этим более циничны в отношении того, как изображения могут обманывать. Они получают удовольствие от того, что изображения могут сообщить, концепциями, которые они проясняют, социальными связями, которые они устанавливают. Зрители не обязательно ожидают от фотографии транскрипции реальности, но они также не полностью разочаровались в ее обещании сохранить момент. Благоразумие и отрицание идут рядом.

Аудитория, конечно, по-прежнему ищет некую «фотографическую привлекательность» в реализме, но эта тяга к реализму не должна смешиваться с жаждой доказательности. Наиболее широкое распространение, особенно в наше время, получают не «самые реалистичные» изображения, а те из них, что оптимизированы для привлечения внимания. Однако, дипфейки не предназначены для пристального внимания. Они скорее созданы для поверхностного просмотра. Дипфейк со злым умыслом работает так же, как маркировка контента: зрители оценивают изображение на предмет правдивости или ложности, и решают, что из этого справедливо. Они рассчитаны на то, что будут приняты за правду, внушая ложную информацию обманутому зрителю. Генерированные изображения, подталкивающие зрителя к готовому результату, и редакционная фотография с ее стереотипами работают схожим образом, стремясь к реализму, который проталкивает предубеждения, выдавая их за общее мнение.

То, что признается «реальным», подлинным – проистекает из убедительных, а не документальных деталей. Реализм – не способ документирования, не степень достоверности, а набор условностей, которые имеют эмоциональную привлекательность, своего рада ностальгия по общей истине, тому, «во что все верят», вместо точнейшего описания. Дипфейк играет на идее, что то, что можно сделать «вирусным», будет казаться все более реальным, пока не достигнет уверенности в духе «Свифта» от бесконечных повторений.

По сути, «известность» изображения становится его основным свойством, если не реальным содержанием, перевешивая то, что на самом деле изображено. Понятие «реализма» становится способом потребления с участием. Реальность присуща не событию, а циркуляции. Но, поскольку наше отношение к реализму становится эмоциональным, оно не решается путем оценки «прошел или нет» в тесте на реальность. Изображения, подвешивающие нас между этими двумя понятиями или разными интерпретациями, могут быть более привлекательными и убедительными, и стать такими же «вирусными» (как показали споры о том, какого цвета было «платье» в 2015 году). Наслаждение «реализмом» – не просто момент подтверждения аутентичности, это еще и балансирование между реальным и возможным.

Можно называть эти изображения «глубокими реальностями», фразой, которую использовал социолог Натан Юргенсон жля описания видео, сделанных во время недавнего «сезона торнадо» в Небраске. Для многих людей вихри в этих видео кажутся слишком реалистичными, чтобы быть правдой – слишком похожими на генерированные ИИ. К той же категории относится памятная фотография Дональда Трампа после покушения. «Глубокая реальность» – это то, что происходит, когда документальный кадр оказывается похожим на фейк, на генерированное изображение. Это своего рода реальность, которая зависит от повсеместности сгенерированных изображений и тревоги по их поводу и играет на этом. Они слишком хорошо подходят под ускоренное визуальное потребление; это реальные изображения, выдвигающие на первый план спецэффекты, которых на самом деле нет. Такие изображения не заставляют предвзятые и часто желаемые представления о мире исчезать в само собой разумеющейся визуальности. Вместо этого они настаивают на том, что формальные качества изображения некоторым образом конфликтуют с содержанием из-за уместности или очевидности. Вместо того, чтобы, подобно дипфейку, пытаться подавить наш скептицизм, глубокая реальность вызывает этот скептицизм на более глубинном уровне, при этом непосредственная сила изображения скорее вызывает сомнения, чем подтверждает его правдивость. Когда дипфейк представляет идею, он намеренно скрывает манипуляцию, пытаясь казаться «истинной фотографией». Когда же глубокая реальность предлагает нам готовую концепцию, она выдвигает на первый план то, что может восприниматься как манипуляция, бросая нам вызов увидеть изображение по-новому.

Оригинал на сайте Aperture

Перевод с английского Александра Курловича